推倒万亿参数大模型内存墙 从第一性原理看神经网络量化、数据处理与存储支持

随着人工智能模型的参数规模突破万亿,内存墙成为训练和部署大型神经网络的关键瓶颈。本文从第一性原理出发,深入剖析神经网络量化的理论基础与实践路径,并结合数据处理与存储支持服务,探讨如何高效突破内存限制,推动大模型技术的可持续发展。

一、内存墙的挑战与根源

内存墙是指模型在训练和推理过程中,由于参数数量庞大,导致内存带宽和容量成为性能的主要限制因素。以万亿参数模型为例,如果使用32位浮点数存储,仅参数就需占用约4TB内存,远超当前硬件设备的常规配置。这不仅增加硬件成本,还拖慢计算速度,限制模型在边缘设备上的部署。其根源在于传统浮点表示法在精度和效率之间的不平衡,亟需通过量化技术优化。

二、神经网络量化的第一性原理

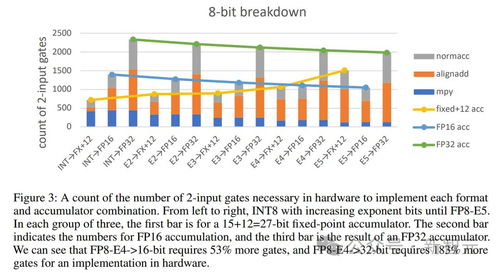

量化旨在将高精度浮点参数转换为低精度整数或定点数,从而减少内存占用和计算开销。从信息论和数值分析的角度,量化可以视为一种有损压缩过程,核心在于在保持模型性能的前提下,最小化信息损失。

- 理论基础:量化基于分布假设和误差容忍性。神经网络的权重和激活值通常服从高斯或拉普拉斯分布,通过非均匀量化(如对数量化)或均匀量化,可以保留关键信息。第一性原理要求我们回归本质:量化误差的传播必须控制在模型容错范围内,这涉及梯度分析、损失函数敏感度评估等。

- 实践方法:包括后训练量化(PTQ)和量化感知训练(QAT)。PTQ直接对预训练模型进行量化,适用于快速部署;QAT在训练过程中模拟量化效应,提升模型鲁棒性。例如,将32位浮点量化为8位整数,可减少75%的内存占用,同时通过校准技术维持准确率。

三、数据处理的关键角色

高质量的数据处理是量化成功的前提。数据预处理、增强和归一化能够优化数值分布,减少量化带来的偏差。例如,通过数据标准化将输入值缩放到固定范围,可以避免异常值对量化区间的干扰。数据流水线设计需与量化策略协同,确保训练和推理阶段的一致性。

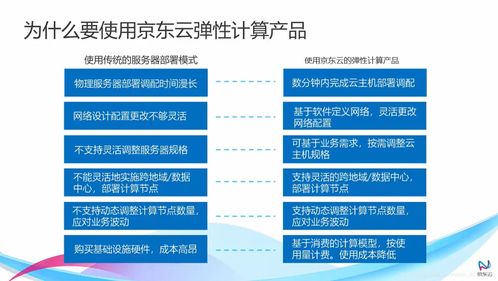

四、存储支持服务的创新

面对海量参数,分布式存储和高效缓存机制至关重要。云原生存储服务(如对象存储和内存数据库)提供弹性扩展能力,结合量化后的紧凑表示,可大幅降低存储成本。例如,采用分层存储架构,将高频访问参数置于高速内存,低频参数存储于低成本介质。新兴的非易失性内存(NVM)技术有望进一步打破带宽瓶颈。

五、未来展望与总结

神经网络量化并非万能钥匙,需与模型压缩、稀疏化等技术结合。从第一性原理出发,我们应持续探索量化极限,例如1位二值网络的潜力。跨学科合作(如硬件-算法协同设计)将推动内存墙的彻底瓦解。通过量化、数据处理和存储服务的深度融合,万亿参数大模型有望在资源受限环境中实现高效部署,开启AI新纪元。

如若转载,请注明出处:http://www.520hbwl.com/product/43.html

更新时间:2025-11-29 03:43:19